Tirgos ne vien mūsu uzmanību, bet arī nākotnes plānus? Brīdina par jauniem mākslīgā intelekta radītiem draudiem

Mēs esam jau samierinājušies, ka interneta giganti pelna naudu no mūsu uzmanības – katra klikšķa, skatījuma un nospiestās "patīk" pogas. Taču Kembridžas Universitātes pētnieki Jākubs Čaudrijs (Yaqub Chaudhary) un Džonijs Penns (Jonnie Penn) savā jaunākajā publikācijā "Harvard Data Science Review" brīdina par jaunu, daudz ietekmīgāku tirgu – "nodomu ekonomiku", ko virza mākslīgā intelekta (MI) attīstība.

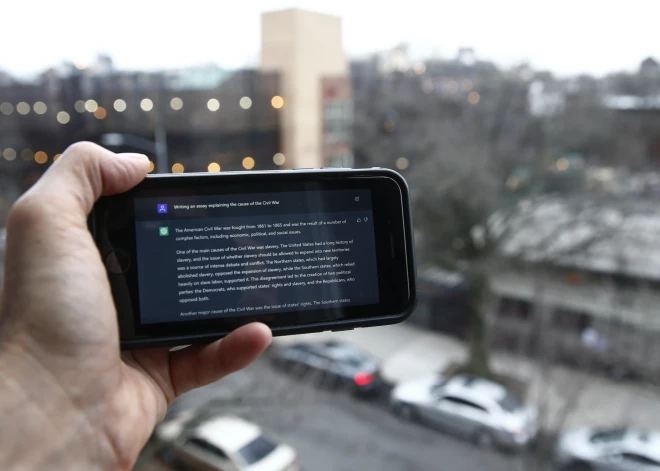

Šī jaunā ekonomika vairs nekoncentrējas tikai uz to, kam mēs pievēršam uzmanību šobrīd, bet gan uz mūsu pašu, iespējams, pat vēl nenojaustajiem nākotnes plāniem, vēlmēm un mērķiem. Lielie valodu modeļi (LLM), kas ir pamatā tādiem rīkiem kā “ChatGPT”, kļūst par galveno instrumentu šo nodomu iegūšanai, analīzei un, visbeidzot, pārdošanai. Pētnieki uzsver, ka šis instruments nākotnē var ietekmēt arī politiskās izvēles un kļūt par nopietnu apdraudējumu demokrātijai.

No uzmanības uz nodomiem

Līdz šim digitālā telpa darbojās pēc uzmanības ekonomikas principiem, kur mūsu laiks un uzmanība tika uzskatīti par galveno valūtu, lai mēs varētu bez maksas lietot tādas platformas kā “Facebook” vai “Instagram”. Taču Čaudrijs un Penns apgalvo, ka notiek pāreja uz jaunu fāzi.

"Nodomu ekonomiku" viņi definē kā "digitālo tirgu komodificētiem nodomu signāliem". Citiem vārdiem, tehnoloģiju uzņēmumi sāk tirgot nevis mūsu uzmanību bet gan mūsu plānus. Kā norāda pētnieki: "Nodomu ekonomika ir uzmanības ekonomika, kas attēlota laikā". Tā cenšas profilēt mūsu uzmanības loku – kā tas mainās, nostiprinās un savienojas ar uzvedības modeļiem dažādos laika mērogos.

Piemēram, ja uzmanības ekonomikā reklāmdevējs jums rāda filmas reklāmu, tad nodomu ekonomikā MI aģents, analizējot jūsu saraksti, varētu secināt: "Jūs minējāt, ka jūtaties pārstrādājies. Vai man rezervēt biļeti uz to filmu, par kuru mēs runājām?" Šāds piedāvājums būtu dinamiski pielāgots jūsu rakstības stilam, uzskatiem, vecumam un pat emocionālajam stāvoklim, lai maksimizētu iespēju, ka jūs piekritīsiet.

Lielo tehnoloģiju gigantu ambīcijas

Pētījumā uzsvērts, ka vadošie tehnoloģiju uzņēmumi jau aktīvi pozicionē sevi šajā jaunajā tirgū. “Microsoft OpenAI” atklāti paziņojis, ka meklē "datus, kas pauž cilvēka nodomus". Savukārt Microsoft veic "lielāko infrastruktūras izbūvi, kādu cilvēce jebkad ir pieredzējusi", lai nodrošinātu jaudu šiem jaunajiem MI modeļiem, un plāno, ka LLM kļūs par pirmo saskares punktu starp cilvēku un jebkuru digitālo sistēmu.

“NVIDIA” vadītājs Jensens Huangs (Jensen Huang) ir paziņojis, ka nākotnē, ikreiz, kad jūs mijiedarbosieties ar datoru, jūs, visticamāk, vispirms sazināsieties ar lielu valodu modeli. Šis modelis izdomās, kāds ir jūsu nodoms, kāda ir jūsu vēlme, ko jūs mēģināt darīt".

“Meta”, uzņēmums, kam pieder “Facebook” un “Instagram”, ir izstrādājis MI aģentu CICERO, kas spēj ne tikai paredzēt citu spēlētāju nodomus stratēģiskā spēlē, bet rī ar valodas palīdzību mainīt otra spēlētāja domas, piedāvājot abpusēji izdevīgus gājienus. Šī tehnoloģija demonstrē potenciālu ietekmēt lietotāju lēmumus.

Šie uzņēmumi vairs neaprobežojas ar datu vākšanu, bet aktīvi veido sistēmas, kas spēj izvilināt, secināt, apkopot, reģistrēt, saprast, prognozēt un galu galā manipulēt, modulēt un komodificēt cilvēku plānus un mērķus", sākot ar ikdienišķiem lēmumiem (viesnīcas izvēle) un beidzot ar nozīmīgiem (politiķa izvēle).

Personalizēta manipulācija un riski demokrātijai

Jaunās tehnoloģijas paver bezprecedenta iespējas personalizētai manipulācijai. Atšķirībā no agrākām metodēm, kas balstījās uz "patīk" pogām, kā tas bija “Cambridge Analytica” skandāla gadījumā, LLM spēj veikt nepārtrauktu "kalibrēšanu", pielāgojoties lietotāja dialogam un uzvedībai reāllaikā.

Pētnieki brīdina, ka MI var pielāgot savu komunikācijas stilu, lai tas atbilstu lietotāja psiholoģiskajam profilam, tādējādi efektīvāk mainot viņa attieksmi un uzvedību. Slēpti ietekmēt viedokli - pat šķietami neitrālas funkcijas, piemēram, teksta autokorekcija, var pārtraukt individuālos domāšanas procesus, novirzot lietotāja domu gaitu sev vēlamā virzienā. Apietu privātuma aizsardzību - Tā kā MI spēj izsecināt privātu informāciju no paša sarunas satura, tas var kļūt par veidu, kā apiet ierobežojumus, kas saistīti ar trešo pušu sīkdatņu izmantošanu.

Autori secina, ka šādas sistēmas rada nopietnus draudus. Iespēja prognozēt un ietekmēt cilvēku nodomus var tikt izmantota ne tikai komerciāliem, bet arī politiskiem mērķiem, apdraudot "brīvas un godīgas vēlēšanas, brīvu presi, godīgu tirgus konkurenci un citus demokrātiskas dzīves aspektus". Tāpēc, pēc viņu domām, šis jaunais "nodomu tirgus" prasa "pastiprinātu zinātnisko, pilsonisko un regulatīvo uzraudzību".

Kā mākslīgais intelekts varētu ietekmēt cilvēka politisko izvēli?

Psiholoģiskā mikro-mērķēšana: MI, nepārtraukti analizējot jūsu saraksti, izveido ārkārtīgi detalizētu psiholoģisko profilu. Politiska kampaņa, piekļūstot šiem datiem, varētu katram vēlētājam ģenerēt unikālu, personisku uzrunu, kas balstīta uz viņa specifiskajām bailēm, cerībām un vērtībām.

Slēptā pārliecināšana sarunās: MI teksta papildināšanas funkcija var piedāvāt pabeigt jūsu teikumu ar maigāku vai neitrālāku frāzi, kad jūs rakstāt ko kritisku par kādu politiķi. Šī "latentā pārliecināšana" var nemanāmi mainīt jūsu viedokli laika gaitā.

Dinamiska dezinformācija: Tā vietā, lai izplatītu vienas un tās pašas viltus ziņas, MI varētu ģenerēt katram lietotājam pielāgotu dezinformāciju, kas vislabāk atbilstu viņa esošajiem aizspriedumiem un padarītu to maksimāli ticamu.

Informācijas "burbuļa" cementēšana: Jūsu personīgais MI asistents ātri iemācītos jūsu politiskos uzskatus un sāktu jums atlasīt tikai tās ziņas, kas tos apstiprina, efektīvi jūs izolējot no pretējiem viedokļiem un padarot jūs imūnu pret jebkādiem pretargumentiem.

Mediju atbalsta fonda ieguldījums no Latvijas valsts budžeta līdzekļiem. Par publikācijas "Pētnieki brīdina par mākslīgā intelekta radītiem draudiem demokrātijai" saturu atbild Izdevniecība Rīgas Viļņi.