Viltoti un noskatīti miljoniem reižu - mākslīgā intelekta video ar Maduro aizturēšanu ir vairāk nekā reālo kadru

Pēdējo mēnešu laikā informācijas telpā arvien biežāk parādās mākslīgā intelekta radīti viltoti attēli un video, kas tiek izmantoti dezinformācijas izplatīšanai.

Viens no spilgtākajiem un aktuālākajiem piemēriem ir MI ģenerēti materiāli par Venecuēlas prezidenta Nikolasa Maduro sagūstīšanu.

Redzēti miljoniem reižu

2026. gada sākumā, uzreiz pēc ASV uzbrukumiem Venecuēlai, sociālajos tīklos strauji izplatījās attēli un video, kuros it kā redzams, ka Venecuēlas prezidents ir aizturēts un atrodas ASV tiesībsargājošo iestāžu kontrolē.

Dažos materiālos bija redzami bruņoti cilvēki ar uzrakstiem, kas atgādināja ASV federālo dienestu simboliku, citos – it kā masu svinības Karakasas ielās, kas, kā tika apgalvots, notiek pēc prezidenta gāšanas. Ieraksti tika papildināti ar apgalvojumiem, ka Venecuēlā notikusi varas maiņa.

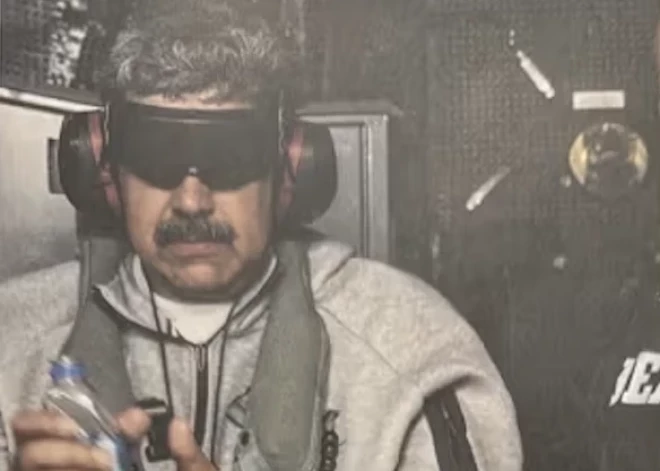

Līdz brīdim, kad Tramps publicēja īstu fotogrāfiju, kurā Maduro redzams ar aizsietām acīm, rokudzelžos un pelēkā sporta tērpā uz karakuģa klāja, viltotie attēli ar ASV Narkotiku apkarošanas pārvaldes aģentiem jau bija kļuvuši ļoti populāri. Saskaņā ar faktu pārbaudes vietnes “NewsGuard” datiem, mākslīgā intelekta radītās fotogrāfijas platformās “X”, “Instagram”, “Facebook” un “TikTok” ir redzētas un kopīgotas miljoniem reižu.

Ģenerēti ar mākslīgā intelekta rīkiem

Drīz pēc tam vairāki neatkarīgi faktu pārbaudes projekti un mediji sāka analizēt izplatītos materiālus. Izpēte atklāja, ka attēliem ir raksturīgas pazīmes, kas liecina par to mākslīgo izcelsmi – deformētas sejas detaļas, nesakritības apgaismojumā, nepareizi uzraksti uz formastērpiem, kā arī neloģiska fonu un objektu kombinācija.

Faktu pārbaudītāji secināja, ka daļa attēlu ir pilnībā ģenerēti ar mākslīgā intelekta rīkiem, savukārt citi ir veidoti, apvienojot īstus foto no agrākiem notikumiem ar mākslīgi radītiem elementiem. Piemēram, Karakasas ielu skati tika ņemti no vecām fotogrāfijām, bet tajās “ievietoti” jauni cilvēki un simboli, kas nekad tur nav bijuši. Video gadījumā tika izmantoti fragmenti no citām valstīm vai pat no inscenētiem treniņiem, pievienojot mākslīgi radītas detaļas un maldinošus aprakstus.

Оrganizētа izplatīšanа

Šī dezinformācijas kampaņa tika izplatīta ļoti koordinēti. Vienādi vai līdzīgi ieraksti parādījās dažādās platformās gandrīz vienlaikus, bieži no kontiem ar nelielu sekotāju skaitu, neskaidru izcelsmi un bez iepriekšējas aktivitātes vēstures. Tas liecina par iespējamu automatizētu vai organizētu izplatīšanu, kuras mērķis bija panākt maksimālu sasniedzamību īsā laikā, pirms parādās oficiāli noliegumi.

Eksperti norāda, ka šāda veida viltoti materiāli ir īpaši bīstami, jo vizuāla informācija cilvēkiem bieži šķiet uzticamāka nekā teksts. Attēls vai video rada spēcīgu emocionālu iespaidu un var veicināt strauju, nepārdomātu reakciju, īpaši politiski saspringtā situācijā.

Pietiek ar piemērotu programmu

Šis gadījums izgaismo arī plašāku problēmu – mākslīgā intelekta rīku pieejamība ļauj salīdzinoši viegli radīt pārliecinošus viltotus materiālus bez dziļām tehniskām zināšanām. Ja agrāk šāda līmeņa viltojumu izveide prasīja laiku un resursus, tad tagad pietiek ar dažām komandām un piemērotu programmu. Tas būtiski apgrūtina sabiedrības spēju atšķirt patiesu informāciju no safabricētas.

Šis gadījums arī kalpo kā brīdinājums gan medijiem, gan sabiedrībai kopumā. Tas parāda, cik svarīgi ir pārbaudīt informācijas avotus, meklēt apstiprinājumu vairākos neatkarīgos medijos un nepaļauties tikai uz sociālajos tīklos redzēto. Vienlaikus tas uzliek lielāku atbildību žurnālistiem, faktu pārbaudītājiem un platformu uzturētājiem, kuriem nākas arvien ātrāk reaģēt uz jauniem dezinformācijas veidiem.

Šī epizode skaidri apliecina, ka cīņa pret dezinformāciju nākotnē būs cieši saistīta ar tehnoloģiju attīstību. Jo sarežģītāki kļūs mākslīgā intelekta rīki, jo nozīmīgāka būs kritiskā domāšana un medijpratība kā sabiedrības aizsardzības mehānisms pret manipulatīviem un maldinošiem vēstījumiem.

Mediju atbalsta fonda ieguldījums no Latvijas valsts budžeta līdzekļiem. Par publikācijas "Viltoti un noskatīti miljoniem reižu - mākslīgā intelekta video ar Maduro aizturēšanu ir vairāk, kā reālo kadru" saturu atbild Izdevniecība Rīgas Viļņi.